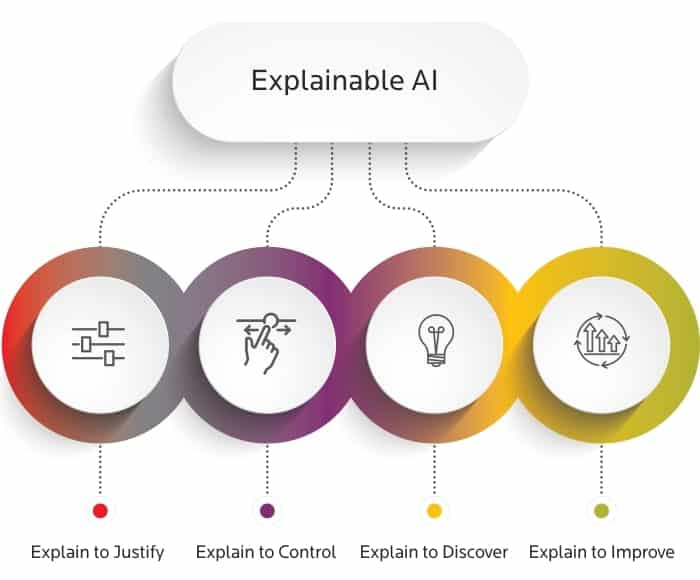

Explainable AI (XAI): Menuju Kecerdasan Buatan yang Dapat Dipercaya dan Dipahami

Kecerdasan Buatan (AI) telah berkembang pesat dalam beberapa tahun terakhir, mencapai tingkat akurasi yang luar biasa dalam berbagai tugas, mulai dari pengenalan gambar hingga pemrosesan bahasa alami. Namun, di balik kemampuannya yang mengesankan, seringkali tersembunyi "kotak hitam" kompleks yang sulit dipahami. Model-model AI, terutama yang berbasis pada jaringan saraf tiruan (neural networks) yang dalam (deep learning), seringkali beroperasi sebagai entitas yang misterius, membuat keputusan berdasarkan pola dan hubungan yang tidak jelas bagi manusia.

Keterbatasan ini memunculkan kebutuhan mendesak akan Explainable AI (XAI), sebuah bidang penelitian yang berfokus pada pengembangan model dan teknik AI yang lebih transparan dan mudah dipahami. XAI bertujuan untuk membuka "kotak hitam" AI, memungkinkan kita untuk memahami bagaimana dan mengapa model AI membuat keputusan tertentu.

Mengapa Explainable AI Penting?

Pentingnya XAI tidak bisa dilebih-lebihkan, terutama ketika AI semakin banyak digunakan dalam aplikasi yang berdampak tinggi, seperti perawatan kesehatan, keuangan, hukum, dan pengambilan keputusan publik. Berikut adalah beberapa alasan mengapa XAI sangat penting:

Kepercayaan dan Akuntabilitas: Dalam aplikasi kritis, kepercayaan adalah segalanya. Jika kita tidak memahami bagaimana model AI membuat keputusan, sulit untuk mempercayai hasilnya, terutama jika keputusan tersebut memiliki konsekuensi yang signifikan. XAI memungkinkan kita untuk memverifikasi dan memvalidasi keputusan AI, memastikan bahwa mereka adil, akurat, dan sesuai dengan nilai-nilai etika. Selain itu, XAI memungkinkan kita untuk meminta pertanggungjawaban model AI jika terjadi kesalahan atau bias.

Keamanan dan Keandalan: Model AI yang tidak dapat dijelaskan rentan terhadap kesalahan dan kerentanan yang tidak terduga. XAI membantu kita untuk mengidentifikasi dan memperbaiki potensi masalah sebelum mereka menyebabkan kerusakan. Dengan memahami bagaimana model AI beroperasi, kita dapat merancang sistem yang lebih aman dan lebih andal.

Peningkatan Model: XAI tidak hanya tentang memahami keputusan AI, tetapi juga tentang meningkatkan kinerja model. Dengan menganalisis penjelasan yang dihasilkan oleh XAI, kita dapat mengidentifikasi fitur-fitur yang paling penting, memperbaiki bias, dan meningkatkan akurasi model.

Kepatuhan Regulasi: Semakin banyak regulator di seluruh dunia yang mulai memberlakukan peraturan yang mengharuskan transparansi dan akuntabilitas dalam penggunaan AI. XAI membantu organisasi untuk mematuhi peraturan ini dan menghindari sanksi hukum. Misalnya, GDPR (General Data Protection Regulation) di Eropa memberikan hak kepada individu untuk mendapatkan penjelasan tentang keputusan otomatis yang memengaruhi mereka.

Penerimaan Pengguna: Pengguna lebih cenderung menerima dan menggunakan sistem AI jika mereka memahami bagaimana sistem tersebut bekerja dan mengapa sistem tersebut membuat keputusan tertentu. XAI meningkatkan kepercayaan pengguna dan mendorong adopsi AI yang lebih luas.

Teknik-Teknik dalam Explainable AI (XAI)

Ada berbagai teknik XAI yang tersedia, masing-masing dengan kelebihan dan kekurangan yang berbeda. Secara umum, teknik XAI dapat dikelompokkan menjadi dua kategori utama:

Model-Agnostic Explanation: Teknik ini dapat diterapkan pada berbagai jenis model AI, tanpa memerlukan pengetahuan khusus tentang arsitektur internal model. Model-agnostic explanation memperlakukan model AI sebagai "kotak hitam" dan mencoba untuk memahami perilaku model dengan menganalisis input dan outputnya. Beberapa contoh teknik model-agnostic explanation meliputi:

- LIME (Local Interpretable Model-Agnostic Explanations): LIME menjelaskan prediksi model dengan membangun model linier lokal di sekitar titik data tertentu. LIME memberikan wawasan tentang fitur-fitur mana yang paling penting dalam memengaruhi prediksi model untuk instance tertentu.

- SHAP (SHapley Additive exPlanations): SHAP menggunakan konsep nilai Shapley dari teori permainan kooperatif untuk mengukur kontribusi setiap fitur terhadap prediksi model. SHAP memberikan penjelasan yang komprehensif dan konsisten tentang bagaimana fitur-fitur memengaruhi prediksi model secara keseluruhan.

- Permutation Feature Importance: Teknik ini mengukur pentingnya fitur dengan mengacak nilai fitur dan mengamati bagaimana kinerja model terpengaruh. Fitur yang menyebabkan penurunan kinerja yang signifikan dianggap lebih penting.

Model-Specific Explanation: Teknik ini dirancang khusus untuk jenis model AI tertentu, seperti jaringan saraf tiruan atau pohon keputusan. Model-specific explanation memanfaatkan pengetahuan tentang arsitektur internal model untuk menghasilkan penjelasan yang lebih mendalam. Beberapa contoh teknik model-specific explanation meliputi:

- Grad-CAM (Gradient-weighted Class Activation Mapping): Grad-CAM menggunakan gradien dari lapisan konvolusi terakhir dalam jaringan saraf tiruan untuk menghasilkan peta panas yang menunjukkan bagian-bagian gambar mana yang paling penting dalam memengaruhi prediksi model.

- Decision Tree Visualization: Pohon keputusan secara inheren mudah dipahami karena struktur hierarkisnya. Visualisasi pohon keputusan memungkinkan kita untuk melihat aturan-aturan yang digunakan oleh model untuk membuat keputusan.

- Attention Mechanisms: Dalam model berbasis perhatian (attention-based models), mekanisme perhatian memberikan wawasan tentang bagian-bagian input mana yang paling relevan untuk menghasilkan output.

Tantangan dalam Explainable AI (XAI)

Meskipun XAI telah membuat kemajuan yang signifikan, masih ada beberapa tantangan yang perlu diatasi:

Trade-off antara Akurasi dan Explainability: Seringkali, ada trade-off antara akurasi model dan explainability. Model yang lebih kompleks, seperti jaringan saraf tiruan yang dalam, cenderung lebih akurat tetapi kurang dapat dijelaskan. Sebaliknya, model yang lebih sederhana, seperti pohon keputusan, cenderung lebih mudah dijelaskan tetapi kurang akurat. Menemukan keseimbangan yang tepat antara akurasi dan explainability adalah tantangan utama dalam XAI.

Subjectivity of Explanations: Penjelasan yang baik bersifat subjektif dan tergantung pada audiens. Penjelasan yang berguna bagi seorang ilmuwan data mungkin tidak berguna bagi seorang pengguna akhir. XAI perlu mempertimbangkan kebutuhan dan latar belakang audiens saat menghasilkan penjelasan.

Scalability: Beberapa teknik XAI tidak dapat diskalakan dengan baik untuk model yang sangat besar atau dataset yang sangat besar. Mengembangkan teknik XAI yang efisien dan dapat diskalakan adalah tantangan penting.

Evaluation of Explanations: Sulit untuk mengevaluasi kualitas penjelasan secara objektif. Metrik yang umum digunakan, seperti akurasi dan presisi, tidak cukup untuk mengukur kualitas penjelasan. Perlu dikembangkan metrik baru yang lebih komprehensif untuk mengevaluasi penjelasan.

Masa Depan Explainable AI (XAI)

Masa depan XAI sangat cerah. Dengan semakin banyaknya aplikasi AI yang berdampak tinggi, kebutuhan akan XAI akan terus meningkat. Beberapa tren utama dalam XAI meliputi:

- Pengembangan teknik XAI yang lebih canggih dan efisien.

- Integrasi XAI ke dalam siklus pengembangan AI.

- Pengembangan alat dan platform XAI yang mudah digunakan.

- Fokus pada pengembangan penjelasan yang berpusat pada manusia.

- Penelitian tentang etika dan implikasi sosial dari XAI.

Kesimpulan

Explainable AI (XAI) adalah bidang penelitian yang penting dan berkembang pesat yang bertujuan untuk membuat model AI lebih transparan, mudah dipahami, dan dapat dipercaya. XAI memiliki potensi untuk merevolusi cara kita menggunakan AI, memungkinkan kita untuk memanfaatkan kekuatan AI sambil memastikan bahwa keputusan AI adil, akurat, dan sesuai dengan nilai-nilai etika. Meskipun masih ada tantangan yang perlu diatasi, masa depan XAI sangat menjanjikan. Dengan terus berinvestasi dalam penelitian dan pengembangan XAI, kita dapat membangun sistem AI yang lebih cerdas, lebih bertanggung jawab, dan lebih bermanfaat bagi masyarakat.